現代のデータ分析において、データベースの選択はプロジェクトの成否を分けます。その中でもPostgreSQLは、多くのデータアナリストから「最後の砦」として信頼されています。

なぜでしょうか? それは、PostgreSQLが単なる「データの入れ物」ではなく、高度な分析関数や柔軟なデータ型を豊富に備えた「分析エンジン」だからです。標準SQLへの準拠度が高く、かつ独自の拡張機能が強力。特にBIツール(TableauやLooker Studio)との相性も抜群です。

しかし、現場でよく耳にする悩みがあります。「クエリが複雑になりすぎて解読不能になる」「集計結果が出るまで数分待たされる」。これでは、スピード感が求められるビジネス分析には対応できません。

本記事では、私が現場で培ってきた経験をもとに、PostgreSQLを「最強の分析武器」に変えるための具体的なテクニックを深掘りしていきます。

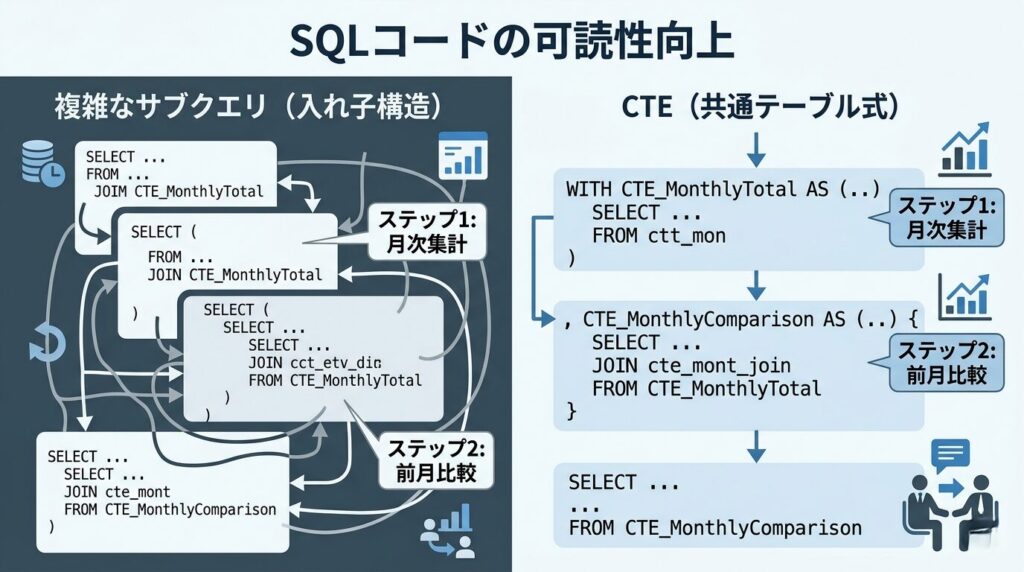

第1章:クエリの可読性を劇的に上げる「CTE(共通テーブル式)」の魔術

データ分析をしていると、サブクエリが何重にも重なり、自分でも何を書いているのか分からなくなる「SQLのスパゲッティ化」に直面することがあります。これを一瞬で解決するのがCTE(Common Table Expressions)、いわゆる「WITH句」です。

なぜサブクエリではなくCTEなのか?

サブクエリは「内側から外側へ」読みますが、CTEは「上から下へ」ロジカルに記述できます。

WITH monthly_sales AS (

— 月ごとの売上を集計

SELECT

date_trunc(‘month’, order_date) AS month,

sum(amount) AS total_amount

FROM sales

GROUP BY 1

),

prev_month_comparison AS (

— 前月との比較計算

SELECT

month,

total_amount,

lag(total_amount) OVER (ORDER BY month) AS prev_amount

FROM monthly_sales

)

SELECT * FROM prev_month_comparison;

このように、処理をステップごとに分割することで、デバッグが容易になり、チームメンバーへの共有もスムーズになります。実務では「まずCTEで一時テーブルを作る」という思考プロセスを持つだけで、ミスが劇的に減ります。

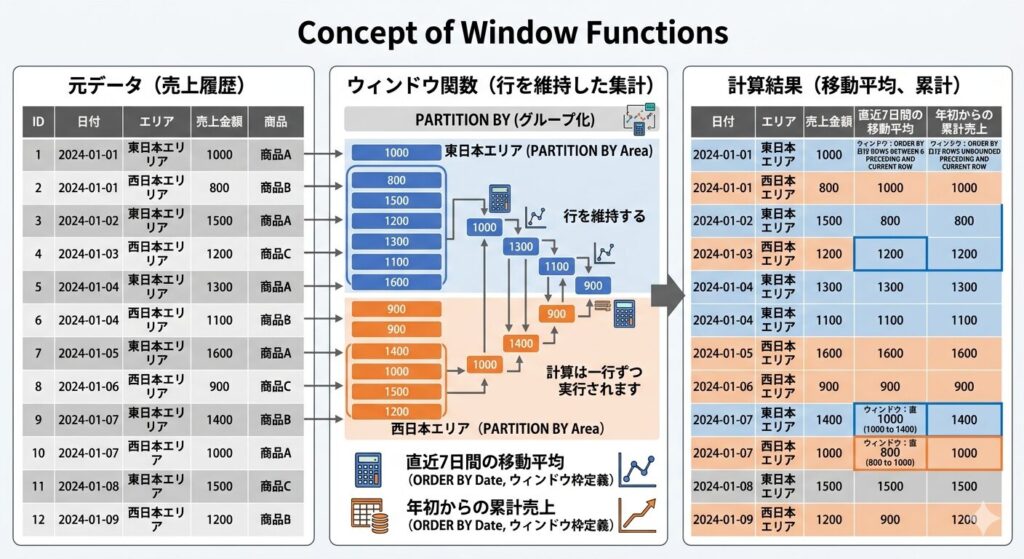

第2章:分析の要「ウィンドウ関数」を使いこなす

PostgreSQLが誇る最強の武器、それがウィンドウ関数(Window Functions)です。GROUP BYとの最大の違いは、「行をまとめずに、行を維持したまま集計値を計算できる」点にあります。

1. 移動平均でトレンドを掴む

売上の変動が激しい場合、日々の数値だけではトレンドを見失います。そこで「直近7日間の移動平均」を使います。

SELECT

sale_date,

amount,

avg(amount) OVER (ORDER BY sale_date ROWS BETWEEN 6 PRECEDING AND CURRENT ROW) as moving_avg_7d

FROM sales;

2. 累計(Running Total)を算出する

「年初からの累計売上」など、時系列の推移を追う際にも、ウィンドウ関数は一行で解決します。

3. RANKとDENSE_RANKの使い分け

同率順位が出た際、次の順位を飛ばすのか(RANK)、詰めたいのか(DENSE_RANK)。こうした細かなビジネス要件に標準機能で応えられるのがPostgreSQLの強みです。

第3章:実務で差がつく!高度なデータ型と演算

PostgreSQLは、構造化データ以外も得意です。特にJSONB型の扱いは、現代のWebサービス分析には欠かせません。

JSONB:スキーマレスの柔軟性とインデックスの両立

「設定値」や「ログデータ」など、カラムを固定できないデータはJSONBで保存しましょう。PostgreSQLはJSONB内の特定キーに対してインデックスを貼ることができるため、数百万件のJSONデータからも瞬時に特定の値を抽出できます。

日付・時刻操作の柔軟性

age()関数やintervalの計算は、他のDBに比べて直感的です。「会員登録から初購入までの期間」を算出する際、PostgreSQLなら驚くほどシンプルに記述できます。

第4章:BIツール連携を加速させるパフォーマンスチューニング

いくら美しいクエリを書いても、結果が返ってくるのが遅ければBIツールのダッシュボードは「使いものにならない」と判断されてしまいます。

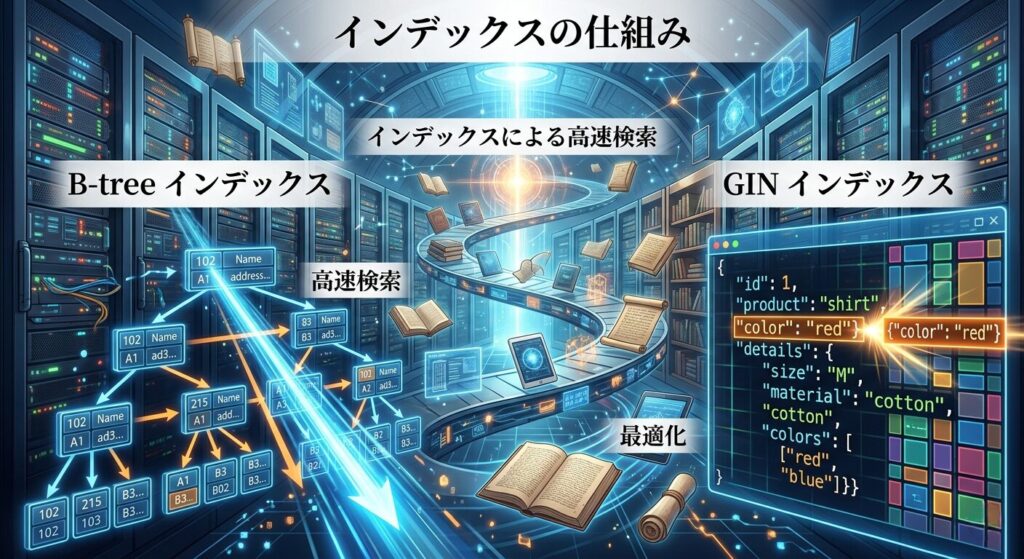

1. インデックスの真実:B-treeだけではない

多くの人がとりあえず「B-treeインデックス」を貼りますが、PostgreSQLにはGINインデックス(全文検索やJSON用)やBRINインデックス(時系列順の巨大テーブル用)があります。 特に数億行を超えるログテーブルを扱う場合、BRINインデックスを活用することで、ストレージ容量を抑えつつ爆速な検索が可能になります。

2. 「EXPLAIN ANALYZE」と対話する

「なぜこのクエリは遅いのか?」その答えはすべてEXPLAIN ANALYZEの中にあります。

- Seq Scan:インデックスが使われず全件探索している。

- Hash Join:メモリ不足でディスクI/Oが発生していないか。 実行計画を読み解く力こそが、シニアアナリストへの第一歩です。

3. パーティショニングで巨大データを分割

日付単位でテーブルを分割する「宣言的パーティショニング」は、データ分析において必須のテクニックです。古いデータをパージするのも容易になり、クエリの走査範囲を劇的に絞り込めます。

第5章:【実例】PostgreSQLで実現する高度な顧客行動分析

ここでは、よくあるビジネス課題をPostgreSQLでどう解決するか具体例を挙げます。

課題:LTV(顧客生涯価値)の高いユーザーの行動パターンを特定したい。

この場合、まずCTEでユーザーごとの初回購入日を特定し、ウィンドウ関数でリピート間隔を算出。さらに、そのデータを特定の属性ごとに集計します。 PostgreSQLなら、この複雑なロジックを一発のクエリで、しかも高速に実行できます。この「一気通貫で分析を完結できる」力こそが、データドリブンな意思決定を支えるのです。

最後に:データに「魂」を吹き込むために

PostgreSQLは非常に多機能ですが、それ自体は道具に過ぎません。大切なのは、その道具を使って「ビジネスの現場で何が起きているのか」を鮮明に描き出すことです。

複雑なクエリが書けるようになること、パフォーマンスを極めること。それらすべての努力は、意思決定の質を高め、ビジネスを加速させるためにあります。

この記事が、あなたのデータ分析ライフを一歩前進させるヒントになれば幸いです。もし、SQLの最適化やBIツールへのデータ連携でお困りの際は、ぜひ私たちInsightFlowにご相談ください。現場を知り尽くしたプロフェッショナルが、あなたのデータの価値を最大化するお手伝いをいたします。

コメント